Les instances internationales de normalisation comptables (International Accounting Standards Board-IASB / IFRS) se sont toutes emparées de la question des enjeux environnementaux.

Les instances internationales de normalisation comptables (International Accounting Standards Board-IASB / IFRS) se sont toutes emparées de la question des enjeux environnementaux.

Que doit prévoir l’autorité des normes comptables (AANC) pour tenir compte de ces enjeux ?

Comment la comptabilité des entreprises doit-elle être au service d’une gouvernance, non seulement de l’entreprise, mais au service du bien commun? Ce bien commun est sensé être accompagné par la puissance publique. Mais, le bien commun ne peut pas, être déconnecté du réel. La comptabilité d’entreprise ne peut donc pas devenir un outil artificiel et formel, sauf à ne plus être garante de performance. Elle sortirait alors de sa mission.

La présente note veut tenter de répondre à deux questions :

- (1) En quoi les risques environnementaux des entreprises sont-ils-avérés? Il serait en effet vain de s'interroger sur les modalités d'intégration d'externalités négatives, si on ne s'interroge pas au préalable, avec un minimum de recul, sur ce qui est qualifiable ou non d'externalité négative.

- (2) Faut-il quantifier des externalités négatives dans les comptes et comment?

Une telle réflexion peut être menée selon le plan suivant :

Analyse: "les2ailes.com"

1- En quoi les risques environnementaux des entreprises sont-ils-avérés ?

1.1- Les risques sur l’environnement local

Les risques de type accidentels

Les risques allégués et fondés sur des études épidémiologiques.

1.2- Les risques sur l’environnement planétaire.

Réflexions d’ordre méthodologique.

Application méthodologique au système climatique planétaire.

Conclusion intermédiaire

2- Faut-il quantifier des externalités négatives dans les comptes et comment ?

2.1- Les questions de principe.

Le concept de crise

La croissance verte est-elle vertueuse ?

2.2- Quelles innovations comptables imaginer pour les risques environnementaux accidentels ?

Le rôle du marché

Les processus vertueux du dialogue assureur/entreprise

2.3- Quelles innovations comptables imaginer pour les externalités planétaires?.

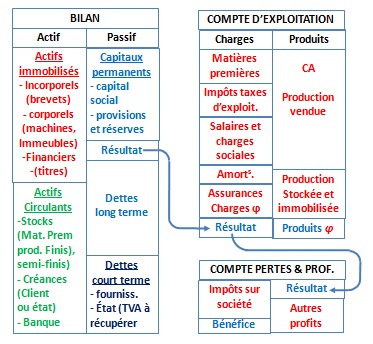

Modifier le passif en rééquilibrant d’autres éléments du passif

Modifier l’actif en rééquilibrant d’autres éléments de l’actif

Augmenter le total du bilan en majorant à la fois certains éléments de l’actif et du passif ?

La souscription d’assurances pour risques planétaires ?

La nécessaire harmonisation internationale

3- Quelles solutions ?

3.1.- L’exemple américain des « red team/blue team ».

3.2- La recherche et développement au service du risque environnemental et du bien commun.

3.3- Que faire ? Quelles urgences pour les entreprises ?

Conclusion

1- En quoi les risques environnementaux des entreprises sont-ils-avérés ?

Il s'agit ici de s'interroger sur ce qui est qualifiable ou non "d'externalité négative". Il convient de distinguer ce qui relève d'un risque local et ce qui serait un risque planétaire. Les méthodes d'évaluation sont très différentes:

1.1- Les risques sur l’environnement local

Les risques de type accidentels

Il ne s’agit pas de nier que les activités des entreprises puissent avoir des impacts sur l’environnement.

Les exemples sont multiples dans le passé : Seveso, Bophal, Tchernobyl, Fukushima.

La mise en place de normes, dites Seveso, pesant sur les entreprises pour réduire la probabilité de ces types d’accidents n’ont malheureusement pas supprimé des risques qui relèvent, par nature, de toute activité humaine. L’exemple de l’incendie survenu en octobre 2019 à l’usine de Lubrizol de Rouen a montré que le nuage de fumées avait eu des répercussions sur plus de 200 communes et 2000 agriculteurs. L’incendie du 3 juillet 2019 à l’usine Seine Aval du SIAAP à Achères, bien que beaucoup moins médiatisé, a eu des effets environnementaux peut-être plus graves encore.

Les risques allégués et fondés sur des études épidémiologiques.

Tout ce qui relève des risques alimentaires, des risques liés aux émissions hertziennes, à l’usage de pesticides en agriculture, sont des problématiques plus difficiles à évaluer.

Selon la gravité des enjeux, on peut avoir recours à plusieurs niveaux de méthodologie :

L’expérience a montré, par exemple, qu’on ne peut tirer des conclusions scientifiquement fiables d’une enquête auprès d’habitants dans le voisinage d’émetteurs de téléphonie.

Ce n’est pas une étude scientifique mais simplement un recensement d’études. Celle publiée par un groupe de travail restreint de l’Organisation Mondiale de la Santé est arrivé à la conclusion que le glyphosate était « probablement cancérigène ». Reste à vérifier si ces monographies sont représentatives d’une vraie controverse scientifique ou si elles sont rassemblées à charge en fonction d’un objectif partiel.

Accessoirement, il n’est pas inutile d’aller vérifier si l’auteur de la monographie a déclaré ou non des conflits d’intérêt. Dans le cas cité, l’animateur qui avait conduit le groupe de travail de l’OMS sur le Glyphosate, Christopher J. Portier, n’avait pas fait état de ses activités précédentes dans l’ONG anti-pesticides américaine, Environmental Defense Fund (EDF), ni du contrat qu’il avait passé avec la firme juridique Weitz & Luxenberg chargée d’attaquer Monsanto.

- Les études de laboratoire

Il s’agit d’un stade un peu supérieur. Mais il convient de vérifier les protocoles d’étude (a), de comparer le résumé de l’étude, pouvant être repris par les média de manière simpliste (b) avec la discussion interne aux auteurs de l’étude (c), de voir la qualité de la revue scientifique dans laquelle est publiée l’étude et la renommée de ses reviseurs (d).

Il n’est malheureusement pas rare qu’après publication, une étude soit contestée au point que la revue exige une rétraction de l’étude, contredisant ainsi, les conclusions du comité des pairs. Le cas exemplaire a été celui du retrait de l’étude d’un laboratoire connu qui avait allégué que les O.G.M. seraient cancérigènes. Les souches de rats retenus dans le protocole, Sprague Dawley, étaient connues pour développer spontanément des incidences de cancers élevées. En sept 2019, la revue Nature a demandé à des océanographes de retirer leur article publié onze mois auparavant sur le réchauffement des océans. Ces auteurs étaient pourtant réputés[1].

- Les études épidémiologiques

Il s’agit d’un stade encore plus élaboré au plan de la méthodologie. Elle est donc plus coûteuse. Mais si une question devient obsessionnelle d’un point de vue social, il faut avoir le courage d’y avoir recours.

Le mot épidémie suggère qu’il s’agit d’enquêtes auprès d’un échantillonnage très importants de personnes. Cela peut aller jusqu’à plusieurs dizaines de milliers de personnes. La multiplicité des facteurs possibles à comparer impose l’usage de questionnaires très détaillés sur l’alimentation des personnes interrogées, sur les sports pratiqués, leur profession, leur sexe, leur âge, leur degré de tabagisme, leur consommation éventuelle de stupéfiants, les traitements pharmaceutiques qu’ils suivent pour cause de maladie ou par confort, … Il faut retenir un maximum de critères, de façon à essayer de séparer les facteurs de risques à partir d’algorithmes mathématiques. Un sous échantillonnage des personnes enquêtées peut même être invité à subir un check-up devant un médecin. L’étude épidémiologique doit, par ailleurs, être ce qu’on appelle longitudinale et non pas transversale. Une étude transversale consiste à observer des individus, à un moment donné. Elle sera longitudinale si l’enquête est reprise sur les mêmes personnes dix ans après par exemple.

Pour prendre des décisions relatives aux allégations-santé, il faut avoir recours à des protocoles adaptés aux degrés de gravité d’un problème. Tel ou tel type d’étude sera privilégiée selon qu’il s’agit d’un degré de gravité tangible, ou d’un degré de gravité sociétale. Faute de cela le subjectif non quantifié, ou l’émotionnel seront souvent imposés par des pouvoirs idéologiques divers et variés.

Certes le coût des études épidémiologiques peut être très élevé. Ceci étant, le coût cumulé pour toutes les entreprises d’un secteur soumis à des pressions irrationnelles peut être encore plus considérable si elles sont tenues de modifier inutilement leurs processus industriels. On pourrait recommander, voire subventionner des entreprises pour qu’elles cofinancent, en lien avec les experts universitaires, des études épidémiologiques digne de ce nom. Nous y reviendrons en conclusion.

1.2- Les risques sur l’environnement planétaire

Réflexions d’ordre méthodologique.

L’écologie est une science du complexe. Elle nécessite une forme de pluridisciplinarité qui n’est pas sans poser des problèmes : dans certains domaines, il faut avoir recours à des milliers et des milliers de scientifiques. Ce recours est souvent mis en avant pour prétendre qu’il y a un consensus scientifique. Mais un consensus, dit le Larousse, est toujours une « procédure d’accord » mais ne qualifie pas nécessairement le « contenu de l’accord ».

Sur la question climatique, par exemple, qui sont ces milliers de scientifiques ?

Ce sont des gens aussi divers que des climatologues, des pédologues – parce que les sols stockent du CO2- et des agronomes, des glaciologues, des océanographes, des hélio-sismologues, des biologistes, des mathématiciens, des modélisateurs, des thermodynamiciens, des chimistes de l’atmosphère... Tous contribuent à la science de l’écologie, chacune avec sa discipline propre. Et la science écologique a besoin de toutes ces sciences, parce qu’on est face à un système complexe. Il ne s’agit pas ici de contester le sérieux de chacune de ces sciences, et encore moins celui de chacun de ces scientifiques. Chacune, prise une par une, peut être considérée comme une pièce d’un puzzle. La question à se poser, est de savoir si des milliers de pièces du puzzle peuvent donner une cohérence à ce puzzle complexe et permettre d’énoncer une loi écologique. Quelle discipline va rapprocher le glaciologue qui étudie les fontes de glaciers, qui sont une des conséquences des variations climatiques, et ceux qui s’interroge sur leurs causes comme le font les hélio-sismologues au niveau du fonctionnement du soleil ? Comment mettre au même niveau les thermo-physiciens qui réfléchissent aux lois de l’effet de serre, et les vulcanologues qui s’interrogent sur l’impact des éruptions sur le climat ? Chacune de ces disciplines est très sérieuse dans ses analyses. Mais les unes s’occupent des conséquences, les autres des causes. Qu’est ce qui va leur donner une cohérence suffisamment légitime pour énoncer une vérité scientifique ?

Il ne s’agit pas d’ériger le « scepticisme » ou le doute, en système de pensée. Il ne suffit pas, non plus de se contenter d’une « croyance », au sens de ceux qui commencent une phrase en disant, « je crois que… ». Il serait malsain que les opinions publiques ne soient réduites qu’à choisir entre des étiquettes très réductrices de climato-sceptique ou de climato-crédule !

Se référer à un consensus, autour de milliers de scientifiques qui « croient que… », relève de l’argument d’autorité. Mais l’autorité des arguments en est-elle pour autant renforcée ?

Quelles sont donc les méthodologies existantes en matière de systèmes complexes planétaires ?

Étant donnée la complexité des systèmes en jeu, il faut bien construire des modèles. Les modélisateurs savent qu’un modèle n’est pas destiné à expliquer une complexité, mais à faire des prévisions à travers cette complexité. Il est classique de reprocher à des épistémologistes de vouloir interpréter tous les types de modèles à partir d’un seul type de modèle. C’est une tentative très courante. Malgré tout, des constantes dans tous les types de modèles sont décelables. Quelles sont ces constances ? Il est possible de les regrouper autour de cinq principes.

On peut aussi les appeler des signaux. Il faut en retenir qui soient indépendants du système et distinguer ce qui sont des signaux d’entrée, des causes, et d’autres qualifiés de sortie, c’est à dire des effets. Il faut, surtout, éliminer tout ce qui ressemblerait à des variables intermédiaires présupposant le résultat du modèle.

Certaines problématiques peuvent se contenter de mesures sur des périodes courtes. Mais quelquefois, il faut être capable de recourir à des données sur des périodes longues. Dans ce cas, il peut être nécessaire d’avoir recours à des « reconstructions » de données. A cette fin, il est possible de recourir à des « proxys ». Un proxy est une mesure de substitution étroitement corrélée à une variable manquante dans une base de donnée. Ces reconstructions de données exigent de « corriger » des données dans le but de reconstruire et de raccorder des séries de données entre elles, tout en veillant à ne pas effacer des réalités, même si ces réalités ne sont pas cohérentes avec le résultat attendu d’une recherche.

Structurer les modèles consiste à retenir des lois simples et robustes et à paramétrer le dit-modèle. Il faut également veiller à ne jamais confondre une cause et un effet. Des boucles de rétroactions internes au système ne peuvent pas être assimilées à des causes.

Il s’agit de quantifier chaque hypothèse causale par des tests d’hypothèses. Une hypothèse est vérifiée en s’assurant que la prévision qui en ressort est conforme aux observations. La quantification ne se limite pas à retenir une hypothèse causale plus qu’une autre, mais va jusqu’au calcul des degrés de confiance à accorder à une relation de cause à effet. Un « test d’hypothèse » est une procédure statistique ayant pour but de fournir une règle de décision permettant, sur la base d’observations, de discriminer deux hypothèses statistiques.

- Les prévisions et vérifications avec les réalisations

C’est le principe fondamental d’un modèle pour qu’il ne soit pas virtuel mais relié au monde réel. Certains imaginent qu’il est difficile de faire des prévisions au motif que les phénomènes observés relèvent d’une temporalité longue et qu’il n’est pas possible d’avoir recours à la méthode expérimentale en laboratoire. Or les statisticiens savent que la mathématique n’est qu’un langage et qu’elle n’a pas le sens du passé et du futur. Ils s’appuient donc sur ce qu’ils appellent « l’hypothèse d’ergodicité », utilisée depuis le 19ème siècle : elle permet de remplacer une série d’expériences par une seule, de durée suffisamment longue. Il suffit de traiter le passé comme un futur. C’est, en quelque sorte, une « rétro-prévision ».

Application méthodologique au système climatique planétaire.

A titre d’exemple, parmi les multiples systèmes complexes planétaires, ces principes peuvent aider à prendre du recul sur les questions d’ordre climatique :

- Les indicateurs climatiques

De manière assez unanime, et à part quelques climato-sceptiques peu crédibles, tout le monde retient la température globale terrestre, comme effet détecté, et comme facteurs causaux éventuels, l’irradiance solaire, les émissions de CO2 et l’activité volcanique. Vouloir prendre d’autres indicateurs comme celui de la hausse du niveau des océans risquerait d’être approximatif. Le niveau des océans est en effet impacté par d’autres facteurs internes au système : les mouvements de la tectonique des plaques qui peuvent faire varier le niveau des océans dans certaines régions (a), les variations de pressions atmosphériques colossales dans les régions du pacifique sud touchées par les phénomènes El Nino et El Nina (b), ou les mécanismes de la circulation thermo-haline qui sont si puissants qu’ont les qualifie de « tapis roulant » au cœur des océans (c).

- L’historique des données climatiques

Le G.I.E.C. est-il légitime à se limiter à 150 ans d’observations[2] ? Ce type de pratique revient à occulter la période chaude médiévale puis le petit âge glaciaire du xve à la fin du xixe siècles au moment de la Bérézina. Pour expliquer ces variations, même un non spécialiste, avec son propre bon sens, peut comprendre qu’il est nécessaire de retenir un minimum d’observations sur mille ans.

- La structuration des modèles climatiques

Presque tous les modèles climatiques utilisent des modèles à transfert d’énergie, (Energy Balance Model – E.B.M.) fondés sur les principales lois de la physique. Il en existe plusieurs types.

Toute la question est alors de savoir à quel espace appliquer ces lois.

(a) La première possibilité est d’englober, en un seul système, la globalité de la mécanique climatique terrestre.

(b) Le G.I.E.C., quant à lui, l’applique à plus de deux cent mille sous-ensembles sous-forme de « planètes numériques » constituée de cubes d’océans de profondeur, de cubes de montagne, ou de toundras, des cubes de haute ou de basse atmosphère, etc …. Malheureusement, la complexité des transferts d’énergie d’un cube à l’autre est telle que les sources d’erreur augmentent, car la complexité engendre l’imprécision.

Ajoutons qu’il ne suffit pas qu’une loi physique, par exemple l’effet de serre, soit vérifiée en laboratoire pour qu’elle suffise à structurer un modèle climatique. En effet, les perturbations colossales des masses d’air peuvent rendre plus complexes le phénomène de l’effet de serre : les masses d’air sont brassées avec une ampleur colossale par les mouvements verticaux des alizés dans les régions tropicales. Ils renvoient des masses d’air chaud, donc émettrice d’infra rouges, à des altitudes où les concentrations de CO2 sont plus faibles. C’est ce qui explique, paradoxalement, que c’est au niveau des tropiques, là où la planète est la plus chaude, qu’elle émet dans le cosmos le plus d’infra rouges[3] !

Par ailleurs, le G.I.E.C., lui-même, reconnait qu’il est conduit à éliminer certains facteurs pour limiter la complexité, en particulier le rôle des nuages : dans leurs modèles, le G.I.E.C. ne retient que « des conditions de ciel clair[4] … ». Pourquoi cela? Parce que, dit le G.I.E.C., « l’introduction de nuages compliquerait grandement les objectifs de la recherche[5]. » Or la recherche devrait se fixer comme mission de faire des prévisions malgré la complexité du système ! Pourtant, tous les climatologues reconnaissent que la vapeur d’eau est également un gaz à effet de serre et que les nuages sont un facteur de rétroaction interne fondamental.

Ce n’est pas une raison pour introduire un phénomène comme El Nino[6] dans les facteurs causaux[7]. Or, il est connu que ces oscillations océano-atmosphériques du Pacifique sud ne sont que des boucles internes de la mécanique climatique, et ne sont pas la cause des variations longues.

Il faut, enfin, structurer le modèle en utilisant des calculateurs avec des algorithmes mathématiques. Le G.I.E.C. qualifie cette étape de « détection-attribution », c’est-à-dire la détection d’un effet et son attribution à une cause. Mais comment s’expliquer que le G.I.E.C. dise que cela « n’exige ni n’implique que chaque aspect de la réponse au facteur causal en question soit correctement simulé[8] » ?

Le G.I.E.C. aborde cette problématique de la « détection-attribution » en utilisant des modèles de planète virtuelle. Les modèles qui travaillent sur un seul système climatique global considèrent que les nuages font partie du système mais ne cherchent pas à expliquer les mécanismes interne de rétro-causalité. Ils s’attachent à l’essentiel : non pas expliquer les relations de cause à effet entre les signaux extérieurs au système, mais les quantifier pour faire des prévisions.

- Le paramétrage des modèles climatiques

Les modèles référencés par le G.I.E.C. introduisent des paramètres, par exemples, la sensibilité de la température à la variation d’émission de CO2 qu’ils exploitent ensuite dans leurs calculs, ou la viscosité des fluides dans les transferts d’énergie d’un cube à l’autre, ou encore des coefficients d’évaporation en fonction de l’état de la mer ou des vents.

Une première méthode consiste à faire des études théoriques et spécifiques pour estimer a priori ces paramètres et les introduire dans le système, avec des degrés d’imprécision qui s’accumulent.

Une autre méthode consiste à laisser le système calculer lui-même quelques-uns de ces paramètres sans aucun a priori, à partir de l’observation des faits et non à partir d’études scientifiques préalables.

Le risque de l’approche des modélisateurs du G.I.E.C. est d’être partial. D’ailleurs un des théoriciens de la modélisation, faisant autorité dans la communauté du G.I.E.C., a fait une enquête et a reconnu que 22 des 23 principaux centres de modélisation climatiques qu’il a interrogés paramétraient leurs modèles « pour obtenir les propriétés souhaitées »[9] ! Pourtant, le principe d’une méthode scientifique est de ne pas préjuger des résultats. Les calculs menés par le G.I.E.C. sur ces paramètres sont d’ailleurs d’une très grande opacité. Il faut une solide expertise scientifique pour arriver à reconstituer certains paramètres comme les sensibilités climatiques retenues par le G.I.E.C.

A contrario, les modèles ne cherchant à identifier qu’un seul système global, parviennent, grâce aux tests d’hypothèses, à calculer les paramètres de sensibilité de la température au CO2, d’irradiance solaire ou d’activité volcanique. C’est ce qui explique que l’utilisation de modèles par identification conduit à des sensibilités complètement différentes de celles du G.I.E.C. Bien entendu, une modélisation sur 150 ans d’observation ne conduit pas aux mêmes sensibilités que celles calculées sur 1000 ans de données.

- La quantification des relations de cause à effet en matière de climat

Nécessairement, ces différences d’approche de paramétrage vont permettre ou non des quantifications précises des relations entre les signaux retenus.

La modélisation alternative fondée sur l’identification d’un système unique global exploite avec rigueur ses tests d’hypothèses. Sa conclusion est que « l’hypothèse, selon laquelle l’activité humaine n’aurait pas d’effet significatif, ne peut pas être exclue... Avec un taux de certitude significatif de 90%..., on doit considérer comme un fait établi que l’activité solaire, en tant que variable explicative causale, constitue l’explication première du « changement climatique »[10].

Le G.I.E.C., travaillant sur une planète numérique multicellulaire, invoque une probabilité de 95% que le réchauffement soit d’origine humaine. L’auteur de cet article a participé à un débat avec deux représentants du G.I.E.C. à qui il était demandé par écrit les références du calcul de 95%. La réponse écrite a été qu’il ne s’agissait pas d’une probabilité calculée mais d’une probabilité subjective. Les rapports du G.I.E.C. le confirment : « les probabilités "Objectives" et "Subjectives" ne sont pas toujours explicitement distinguées »[11]. Peut-on parler de chiffrage et de quantification avec de telles approches ?

- Les prévisions et les réalisations climatiques

Dire que la gravité et l’urgence des enjeux sont telles qu’on n’a pas le temps de vérifier si les modèles auront raison ou tort, relève d’une forme d’esquive. Il suffit de faire, avec les modèles, des « retro-prévisions ». Il est possible de tester les sensibilités retenues par le G.I.E.C. à partir des observations faites sur 150 ans et de reconstruire sur 1000 ans l’histoire climatique antérieure à 1880. Le Giec a publié un résultat de ce type[12]. Il ne dégage qu’un flou effaçant les variations que l’histoire a connu pendant l’« optimum médiéval » du xe au xive siècle et le « Petit âge » glaciaire du xve au xviiie siècle. Ce n’est pas être provocateur que de dire que si un modèle n’est pas capable de restituer l’historique passé, c’est qu’il est inefficient à prévoir le futur.

Conclusion intermédiaire

Curieusement, des centaines de publications, chaque année, font état de travaux sur l’impact de l’activité solaire sur le climat mais ne sont pas référencées dans les rapports du G.I.E.C. Il est pourtant assez aisé d’en prendre connaissance. Il suffit d’utiliser les moteurs de recherche internet avec quelques mots clefs, de préférence en anglais, comme « Elsevier [13] », « soleil », « rayons cosmiques ». En deux heures de recherche, il est aisé d’avoir accès à ces études et d’en lire les protocoles et les conclusions.

L’analyse, menée ci-dessus sur la question climatique, pourrait aussi bien être détaillée sur ce que certains scientifiques appellent les « neuf limites planétaires »[14] : ozone, biodiversité, particules fines, etc… La présente note n’a pas pour objet, de montrer l’absence de bien des indicateurs planétaires sur ces sujets, l’absence de lois permettant de structurer des modèles et l’absence totale de prévisions fournies par ces modèles. L’auteur de ces lignes restent à la disposition du lecteur pour élargir ce type d’analyse aux autres enjeux planétaires.

Dans un tel contexte que recommander en matière de plan comptable pour les entreprises.

2- Faut-il quantifier des externalités négatives dans les comptes et comment ?

En économie, on parle d’externalité lorsque la production ou la consommation d’un agent économique – une entreprise ou un individu – génère un impact positif ou négatif sur le bien-être d’autres agents économiques sans qu’il y ait une transaction ou une contrepartie financière. Le chapitre 1 montre à quel point il faut être prudent avant d’attribuer un impact à une activité ou à une autre cause. C’est pourquoi, il serait quelque peu rapide d’ériger en principe que, dans la réalité économique, la majorité des externalités seraient négatives au prétendu motif que les entreprises font en général payer les services qu’elles rendent et seraient incitées à produire des externalités négatives pour réduire leurs coûts. Il existe de multiples moyens de réduire les coûts et c’est dans les pays dont l’activité est la plus développée que les externalités positives se développent le plus.

Malgré tout, à supposer que telle ou telle externalité s’avère négative, comment la traduire dans les réalités comptables d’une entreprise qui la générerait ?

2.1- Les questions de principe

« Une entreprise est une personne morale dotée d’une « subjectivité », c’est ce qui fait sa force à l’instar d’une personne physique », écrivait Patrick de Cambourg, président de l’Autorité des Normes Comptables (ANC).

C’est aussi ce qui fait sa faiblesse, car le risque existe que la subjectivité l’éloigne du réel. Or une entreprise ne peut se déconnecter du réel, sauf à générer des crises potentielles sur le futur.

Le concept de crise

La création de nouvelles normes comptables environnementales pourraient induire de nouvelles formes de crises financières si ces normes sont déconnectées du réel. Pourtant les crises ont le mérite de rétablir des équilibres économiques quand les forces auxquelles elles sont soumises ont été durablement déconnectées du réel. L’histoire récente de la sub-prime crise a montré qu’une mauvaise intégration de l’insolvabilité potentielle des dettes avait cumulé des tensions telles que la crise était inéluctable, à cause de la résistance des entreprises à comptabiliser ces risques réels.

Certains économistes comparent les situations de crise à celles du mouvement de tectoniques des plaques. Des tensions géologiques de profondeurs s’accumulent suite aux dérives des continents. Régulièrement, des rééquilibrages de la surface visible de la croûte terrestre produisent des tremblements de terre qui, en quelque sorte, sont bénéfiques à l’équilibre général,... bénéfiques au détail près des victimes humaines qui en découlent.

La comparaison entre géologie et économie n’est pas déplacée, dans la mesure où certaines crises économiques font, elles aussi des victimes sous forme de pertes d’actifs des uns ou de chômage chez d’autres.

Comment éviter ces types de risques ? Existerait-il des normes comptables qui permettraient de les limiter ? Le premier principe ne consisterait-il pas à ne comptabiliser que des risques avérés, c'est-à-dire connectés au réel ? La cause humaine des variations climatiques est-elle aussi avérée que les dérives continentales avec les tremblement de terre ?

En matière comptable, ne pas avoir ce souci du réel, ne provoquera-t-il pas, à moyen terme, une green crise, pour les mêmes raisons qu’un déni de réalité a engendré la sub-prime crise ? Suffit-il d’avoir une vision macro-prudentielle dans la mise en œuvre de la supervision pour éviter que de nouvelles crises ne surviennent ?

La croissance verte est-elle vertueuse ?

Certains économistes objecteront que ce principe de réalité n’est pas nécessaire à l’activité économique : si les consommateurs souhaitent des produits verts, pourquoi ne pas les mettre sur le marché ? Si les épargnants veulent des entreprises éthiquement responsables, pourquoi ne pas leur offrir des normes comptables ou des labels éco-responsables ?

Peut-être est-ce oublier que la croissance verte n’est pas vertueuse au seul motif qu’elle crée des emplois. Le marché de l’insécurité publique crée, lui aussi, des emplois dans les sociétés fournissant des services de sécurité (alarmes, gardiennages, …). Est-ce à dire que l’insécurité d’un pays deviendrait un atout économique ? La marchandisation des corps et des organes humains serait-elle un facteur de croissance ? Sans aller jusqu’à porter un jugement éthique sur la PMA ou la GPA, faudrait-il revenir sur le principe de gratuité des dons d’organes au seul motif que le chiffre d’affaire correspondant serait intégré dans le PNB d’une nation ?

De même, la croissance verte est-elle aussi vertueuse qu’il y parait ? La multiplication des normes vertes en matière de produits de consommation est, à la réflexion, conduit à une forme de consommation obligatoire. Cela va de l’interdiction des brûlis qui crée de la croissance dans les jardineries, aux normes d’ampoules basses calories qui augmentent le chiffre d’affaire des équipementiers électriques. Toute consommation rendue obligatoire se fait, en définitive et pour des revenus constants des consommateurs, au détriment d’autre secteurs de consommation. Est-il caricatural de dire que pour le consommateur perd sa liberté de choix entre un achat écologique et un soutien scolaire de ses enfants ? Pourquoi ne parle-t-on jamais de l’application du principe de subsidiarité au monde de la consommation ?

On est tenté de penser que les normes écologiques s’imposent, étant donné la gravité des enjeux environnementaux. La question du principe de réalité, posé au premier chapitre vient, une fois de plus, bousculer nos esprits.

2.2- Quelles innovations comptables imaginer pour les risques environnementaux accidentels ?

Nombreuses sont les dispositions réglementaires destinées à limiter les risques environnementaux de type accidentel : lois d’indemnisation des victimes, responsabilité pénale des chefs d’entreprise, obligation de souscrire des assurances, publication de rapports destinés à informer les actionnaires en matière de risques environnementaux, etc…

Le rôle du marché

Le marché est une forme de sondage à grand échelle : il peut sanctionner l’entreprise de deux façons :

Toute entreprise négligeant la prise en compte de ses impacts environnementaux peut se voir sanctionner par des consommateurs se détournant des produits proposés. De vrais campagnes de boycott peuvent même prendre des ampleurs considérables. Mais force est de reconnaître que c’est souvent sous la pression de campagnes jouant de l’émotion, plus que de prise en compte de risques réels.

La bourse un immense sondage gratuit qui met en jeu des millions d’individus toutes les secondes. Mais ce sondage n’est pertinent que si les individus sont bien informés. Nombreux sont les analystes financiers qui s’efforcent donc de scruter les risques environnementaux avérés pour informer le marché. Mais, l’échange d’information n’est pas forcément pertinent à ce niveau.

Le recours au marché a des vertus très théoriques, car les sujets sont bien trop complexes pour que cela puisse apporter des solutions. Ces outils sont trop souvent des sanctions a postériori et pèsent peu sur la prévention des risques. Ce n’est pas le cas du recours au assurances.

Les processus vertueux du dialogue assureur/entreprise

Les primes sont comptabilisés dans les charges, et l’équilibre comptable de l’entreprise exige donc qu’elle répercute ce coût, in fine, dans ses prix de vente. C’est indirectement le consommateur qui en supporte le coût des assurances.

Ceci étant, pour les risques pesant sur l’environnement de proximité, le jeu des réunions périodiques d’expertise entre les experts d’assurance et les responsables-sécurité internes aux entreprises est un processus vertueux et efficace. Il y a là une forme de débat contradictoire qui conduit à une négociation dont les conclusions sont toujours gagnant-gagnant : l’entreprise investit en sécurité et voit ses primes d’assurance diminuer, et la société d’assurance réduit ses coûts d’indemnisation.

2.3- Quelles innovations comptables imaginer pour les externalités planétaires?

Nous ne retiendrons pas ici les risques à dimension locale. Nous nous interrogeons surtout à propos des risques prétendument planétaires.

Quelles innovations comptables faudrait-il donc envisager ? Jacques de la Rosière, dans une enceinte privée, évoquait cette question en précisant qu’il s’aventurait sur un terrain qui ne relevait pas de sa compétence. Il suggérait, malgré cette prudence préalable, d’inscrire au passif des entreprises, des éléments comptables pour prendre en compte les externalités négatives que les entreprises font peser sur la planète.

N’ayant pas d’expertise comptable, l’auteur de cette note en restera à un questionnement.

Notre réflexion est guidée par ce que rappelle le président de l'Autorité des Normes Comptables, Patrick de Cambourg. Il se fonde sur un « un constat simple : modifier le mode de comptabilisation des actifs, sans mettre en regard les modes de comptabilisation des passifs – qui ne sont pas des instruments financiers – va créer du mismatch comptable et, donc de la volatilité dans les résultats extériorisés ». Voilà une externalité négative imprévue que pourraient produire les entreprises si des principes comptables élémentaires n’étaient pas respectés.

Modifier le passif en rééquilibrant d’autres éléments du passif

Cette première opération peut consister à inscrire au passif,

- des provisions pour risque environnemental,

- ou une dette à long terme dont l’État serait le créancier potentiel.

Si aucune contrepartie n’est prise en compte à l’actif, y a-t-il d’autres solutions que de constater la baisse du résultat d’exploitation. Cette baisse devra être compensée par une hausse des prix de vente de ses produits. Son compte de charges sera-t-il alors augmenté par

- le coût de la provision pour risque ?

- ou le coût des appels de l’État appelant à payer les annuités des emprunts à LT ?

Reste à s’interroger sur le calendrier de mise en œuvre. Faut-il laisser s’accumuler les provisions pour risque et attendre que le risque se réalise ? Quand considérera-ton qu’un risque climatique s’est réalisé ?

Dans les deux cas, le consommateur sera le seul à financer ces écritures. L’état quant à lui, ne sera-t-il pas le seul bénéficiaire en recevant les annuités de ces dettes à long terme. Mais si le risque n’est pas avéré, ne pourrait-on reprocher à l’état une forme d’enrichissement sans cause ? Et comment expliquer aux contribuables qu’ils financent, de manière quasi invisible, une taxe à la consommation au titre de ces écritures comptables ?

Modifier l’actif en rééquilibrant d’autres éléments de l’actif

Une seconde opération peut consister, par exemple, à déprécier un stock de produits pétroliers en le valorisant en dessous de sa valeur de marché.

Comment augmenter en conséquence d’autres éléments de l’actif ?

Serait-il possible que les entreprises acquièrent, en contrepartie, des titres d’institutions financières à vocation environnementale ?

L’émetteur de ces titres pourrait-il être autre que l’état lui-même ? L’expérience des bourses de marchandises montre que la valeur de marché de tels titres est très aléatoire : quand il y a beaucoup d’acheteurs potentiels (les entreprises), mais peu d’acteurs offrants (l’état), il arrive toujours un moment où le marché n’est plus représentatif de l’offre et de la demande. Ce type de mesure ne reviendrait-il pas à transférer le risque environnemental, non plus sur le consommateur, mais sur l’épargnant ?

Par ailleurs, la question du calendrier de dépréciation de l’actif resterait à préciser. Patrick de Cambourg se pose la question : « Analyse au coût historique ou juste valeur, quel est le bon modèle ? ». En cas d’écart entre le prix d’acquisition d’un bien et la juste valeur du bien acquit, plusieurs philosophies existent : amortir l’écart de valeur chaque année, ou ne déprécier que lorsque la baisse de valeur est constatée. Faudrait-il attendre pour déprécier que les dégâts environnementaux climatiques soient constatés et expliqués ? Certains experts semblent dire qu’une dépréciation enregistrée simplement quand la baisse de valeur est constatée permet de réduire le risque de bulle financière. Or, en matière environnementale, si le risque se confirme, dans quelques années, comment étant non avéré, que deviendraient l’accumulation de ces dévalorisations de stocks ?

Augmenter le total du bilan en majorant à la fois certains éléments de l’actif et du passif ?

Le principe reviendrait, par exemple, à obliger les entreprises, à emprunter à des fondations environnementales spécialisées. En contrepartie, elles souscriraient à l’augmentation de capital de ces fondations en inscrivant la contrevaleur de ces actions dans leurs actifs incorporels.

La conséquence ne serait-elle pas d’immobiliser des fonds propres dans des réserves moins liquides, et donc de réduire le fonds de roulement des entreprises ? Cela risquerait de nuire à leur performance financière. N’y aurait-il pas surtout un problème de cohérence avec les besoins d’investissements à long terme pour répondre à d’autres impératifs de long terme de l’entreprise ? On pense, par exemple, au financement des retraites, pour lequel le principe de solidarité avec les générations futures est, hélas, moins invoqué que pour les questions écologiques.

Dans ce cas également, l’état ne serait-elle pas la seule institution légitime pour appeler les annuités de d’une telle dette à long terme ? On retomberait alors devant la même nécessité de l’entreprise d’augmenter les prix de vente de ses produits pour équilibrer son compte de résultat grevé par la charge de ces annuités ?

La souscription d’assurances pour risques planétaires ?

Toute entreprise se doit de s’assurer contre un risque environnemental. Cela peut se concevoir pour des pollutions locales, mais que peut prévoir une société d’assurance face à des risques supposés être planétaires si la cause anthropique de ce risque n’est pas avérée ? Comment ce risque sera-t-il intégré dans le plan comptable des entreprises d’assurance ? Les approximations de chiffrages au plan d’une entreprise ne feraient que s’accumuler au niveau des sociétés d’assurances. Par ailleurs, les variations climatiques n’ont pas que des inconvénients : le réchauffement climatique a eu certains avantages comme celui de l’augmentation de la photosynthèse agricole et forestière. Des émissions de CO2 ne seraient-elles pas des externalités positives pour d’autres activités économiques ? Comment comptabiliser ces externalités positives ?

La nécessaire harmonisation internationale

Comment éviter des distorsions de concurrence entre les entreprises qui se verraient ainsi imposer des contraintes d’exploitation et celles qui en seraient exemptées ? N’y a-t-il pas le risque de voir apparaître de nouveaux paradis fiscaux environnementaux et les délocalisations comptables qui en résulteraient ?

Il ne faudrait pas que les institutions ad’hoc européennes (EFRAG) élaborent des outils sans que les normes comptables convergent avec celle des normes américaines (US GAAP), ou celles d’autres pays, dont le Canada, l’Australie, la Chine ou encore le Japon pour ne citer que des « poids lourds ».

3- Quelles solutions ?

3.1.- L’exemple américain des « red team/blue team »

Notre analyse des risques environnementaux, qu’ils relèvent d’impacts locaux ou planétaires, montre que le consensus ne constitue pas une preuve scientifique. Le consensus n’est qu’un fait social fondé sur des arguments scientifiques. Mais un argument reste un argument. Il n’est pas garant qu’une théorie scientifique reflète la complexité d’une réalité.

En science, le meilleur moyen de revenir au réel, est de financer le débat contradictoire et public. Il est illusoire de penser que les institutions telles que le Giec organisent, en leur sein, ces débats contradictoires. Il n’est qu’à voir les appels à recrutement d’experts : certains laissent croire que le GIEC est l’acronyme d’un groupe d’experts internationaux sur le climat alors que son véritable nom est un groupe intergouvernemental d’étude du climat. Il s’agit donc bien d’une instance de personnes cooptées par les états, dans des équipes universitaires à qui sont alloués la totalité des budgets publics, toujours à des « équipes bleues », la couleur du consensus. Les « équipes rouges », de la couleur de la dissidence ne sont jamais financées. Elles pourraient pourtant utilement rechercher les failles dans les travaux des équipes bleues. Pourquoi aucune université sérieuse ne se voit-elle chargée par l’état d’approfondir l’origine solaire des variations climatiques. L’impossibilité d’obtenir un financement pour ce type de travaux est en tout état de cause révélatrice.

A contrario, les États Unis ont recours à ces méthodes le travail dites « red teams » et « blue teams ». Elles sont couramment utilisées dans certaines universités, mais aussi dans l’armée, ou dans certaines entreprises pour tester des stratégies.

3.2- La recherche et développement au service du risque environnemental et du bien commun

Pourquoi de nouvelles règles comptables et fiscales, n’imposeraient-elles pas aux entreprises de financer des recherches selon la procédure « red teams » et « blue teams ». Elles seraient bienvenues dans les secteurs d’activité de chacune des entreprises, ne serait-ce qu’en contribuant à améliorer la culture interne. Par exemple :

- en matière d’allégation santé, dans des entreprises alimentaires qui pourraient financer des études épidémiologiques

- en matière de modèles climatiques, dans des sociétés énergétiques qui pourraient financer des axes de recherche moins consensuels

- en matière d’ozone, dans les sociétés spécialisées en froid industriel qui pourraient financer des recherches sur l’impact des rayons cosmiques sur le fameux « trou d’ozone ».

Les états pourraient exonérer les dites entreprises de l’obligation de provisionner des risques environnementaux qu’aux deux conditions expresses,

- que leur budgets de recherche sur ces questions respectent bien l’équilibre « red team » et « blue team »,

- que des débats publics et télévisés soient diffusés périodiquement

Ces coûts alourdiraient, bien sûr, le compte de résultat. Les consommateurs seraient toujours les contributeurs finaux de ce processus, mais, en contrepartie, ils pourraient bénéficier d’un surcroît de culture générale lors de la diffusion publique en prime time des débats entre les deux équipes retenues.

3.3- Que faire ? Quelles urgences pour les entreprises ?

Pour ne pas se déconnecter du réel, il y a urgence à ce que les commissions intègrent des dissidents dans leur TEG (Groupes d’experts techniques).

Ces groupes techniques ont-ils jamais entendus un discours dissident sur ces questions ? Ou alors l’affaire climatique est-elle entendue ? Comme disait Valérie Pécresse, « le débat est clos », comme si en sciences un débat pouvait être clos ?

Force est de constater que les universités sont tenues à une forme de soumission au cadre imposé par le politique, puisqu’elles s’autocensurent en n’osant réclamer aucun budget de recherches sur les causes solaires des variations climatiques. Le monde de l’entreprise doit-il accepter, lui aussi de se soumettre au politique ? C’est probablement incontournable.

Dès lors, que faire ? Critiquer ? Il y a là un risque de simplement alimenter un flux de paroles et d’images et d’être l’idiot utile au service des protocoles en cours d’établissement. Si les entreprises sont tenues de se soumettre à des thèses scientifiques plus ou moins fondées qui irriguent désormais toute la Blockchain à laquelle les entreprises ont désormais recours, ce devrait l’être, à tout le moins, en toute conscience.

Deux pistes sont accessibles aux entreprises pour contribuer, malgré tout, à plus de vérité scientifique. La vérité est un enjeu du bien commun auquel les entreprises doivent avoir le souci de contribuer.

a) Intégration du débat scientifique contradictoire dans les budgets d’entreprises:

Comme indiqué au § précédent, il pourrait être envisagé de :

- financer des équipes rouges pour rechercher les failles dans les travaux des équipes bleues.

- intégrer des dissidents en amont, dans les groupes d’experts techniques. C’est quand le dissident appelle à la subsidiarité et appelle à plus de vérité qu’il devient ferment de richesse pour la société. Or la capacité d’une société à laisser émerger les dissidences est un indicateur du niveau de subsidiarité et qu’elle pratique. Prendre le risque de la vérité est une qualité qui libère les énergies et libère le futur !

Ces budgets de recherche pourraient inciter les entreprises à anticiper des stratégies alternatives au cas où les théories consensuelles s’effondreraient sous la pression de l’observation du réel.

Le résultat de ces recherches financées pourrait être diffusé en interne, auprès des salariés, en veillant à ce que la communication interne soit le porte-parole des sans voix, des minoritaires, fussent-ils dissidents. Le goût du débat contradictoire pourrait ainsi devenir une vraie culture d’entreprise. Les retombées ne se limiteraient pas aux débats écologiques, mais serait source de créativité dans tous les domaines : marketing, productivité, nouveaux produits, etc…

b) Modification de toute la sémantique de communication d’entreprise.

- Les expressions de « réchauffement climatique », de « changement climatique », ou de « dérèglement climatique », évoquent à la fois une rupture d’origine humaine dans les évolutions et l’absence de retour possible. Il est suggéré de parler de « variations climatiques » ou de « période chaude climatique », qui incluent l’idée de causes naturelles et d’une réalité constante de l’histoire planétaire, par exemple avec sa période chaude médiévale;

- Ne plus faire référence à des « experts climatiques » mais à des « chercheurs en climatologie », expression induisant moins la certitude que la nécessité de chercher ; Au plan des connaissances, plutôt que d’« expert », parler d’« Observateur scientifique » pour évoquer la pluralité de regards sur la complexité des réalités et, au plan des applications, rappeler que l’« Ingénieur » n’est pas un expert, mais celui qui met humblement en œuvre ses savoirs sous la contrainte des réalités.

- En appeler au « principe de prudence » (évoquant la pesée des bénéfices et des risques), plutôt qu’au « principe de précaution » (évoquant une recherche illusoire du zéro risque)

- Ne plus invoquer des stratégies au nom de la « lutte contre les variations climatiques » (leur « atténuation »), mais dans l’« adaptation » aux dites variations (la mitigation).

- Ne pas en appeler au « consensus scientifique » ni à des « preuves scientifiques », mais plutôt au « consensus social existant en matière de climat » et souhaiter des « débats scientifiques » ou des « approches scientifiques » qui ont le mérite de l’humilité dans la démarche de recherche de la vérité.

- Éviter de parler de « catastrophes naturelles », mais plutôt de « déséquilibres naturels »

- Parler de « mécanique climatique » plutôt que d’un « effet de serre » qui réduit le climat à l’effet du CO2 oubliant l’influence de la vapeur d’eau ou de l’activité solaire.

- L’expression « Énergie renouvelable » entretient la peur d’un épuisement éventuel de ressources qui, en réalité dépendent de la technicité et des besoins d’un moment. Il est suggéré d’utiliser plutôt le concept d’« Énergie maitrisée », montrerait que plus on monte en densité énergétique, plus la part de l'énergie brute dans le coût total de l'énergie diminue.

- L’expression de « Transition énergétique » jette un pont sur un progrès mal défini. Il est préférable de s’en tenir au concept d’ « Avenir énergétique » qui oblige à quantifier l’objectif visé.

- Le terme « biodiversité » est devenu « une figure rhétorique, … pour lui faire produire un effet figuratif de façon… à émouvoir » (André Micoud- CNRS). Elle défend l’idée d’écomusée, d’une forme d’immobilisme, de croissance-zéro, pour éviter l’empreinte écologique de l’homme. Il faut utiliser l’expression « Richesses biologiques » qui rappelle qu’au cours des ères géologiques, précédant l’aventure humaine, un nombre considérable d’espèces est apparu, puis a ensuite disparu.

Les mots ont un poids dans ce qu’ils induisent. Les entreprises pourraient ainsi, tout en restant audibles, contribuer à rétablir une sémantique porteuse de plus de vérité, plutôt que de surfer sur les idéologies en vogue.

Conclusion

Il faut distinguer clairement les données comptables et les données non comptables. Ne relève du comptable que ce qui affecte ou pourrait affecter les comptes à l’avenir. Tant qu’il n’y a pas risque réel de pénalité, judiciaire ou fiscale, ou d’interdiction, les comptes ne sont pas affectés et n’ont pas à l’être.

On devine, dès lors que le seul moyen propre d’intégrer une externalité prétendument négative dans des comptes est une intervention publique relevant du fait politique et non du ressort de l’entreprise. On ne peut pas tout mettre dans les comptes. Certes, l’entreprise se doit d’appliquer la loi, mais si elle n’y prend garde, le politique la transformera, progressivement, en un collecteur d’impôts indirects. Cela pourrait avoir des conséquences sur sa compétitivité internationale.

[1] Océanographe des universités de Princeton, Fudan à Shanghai, du Centre de recherche sur les océans de Kiel et du français L. Popp à LMD/IPSL, ENS, PSL Research University, École Polytechnique, Sorbonne Université, CNRS, Paris, France. Ils ont reonnu qu’un commentateur externe, Nicholas Lewis, les avaient conduits à se « rendre compte d’incertitudes déclarées sous-estimées en raison de leur traitement de certaines erreurs systématiques … qui a considérablement affaibli les implications d'une révision à la hausse du réchauffement des océans et de la sensibilité climatique.» ! (source : https://www.nature.com/articles/s41586-019-1585-5, site consulté le 9.10.2019)

[2] GIEC-IPCC, WG1 Fifth Assestment Report, Chap. 10, Fig. 10.1, p. 107/131 www.climatechange2013.org/images/report/WG1AR5_SOD_Ch10_All_Final.pdf, (consulté le 28/08/19)

[3] Les cameras à infrarouge (source : https://www.youtube.com/watch?v=f7QttjGu628 , consultée le 9.10.2019), mesurant les émissions de la terre à partir de satellites, montrent précisément que c’est dans les zones tropicales que la terre émet le plus d’infrarouges. L’effet de serre n’agit donc pas en réchauffant l’atmosphère par absorption du rayonnement infrarouge émis par la surface, comme on l’enseigne en classes de SVT, avec la bénédiction du GIEC. Au contraire, il agit en refroidissant l’atmosphère par émission d’infrarouges à haute altitude. Plus la concentration de GES est forte, plus l’altitude d’émission est élevée, et plus la surface doit être chaude pour générer une circulation atmosphérique capable de transférer à plus haute altitude un même flux énergétique à l’équilibre. Conceptuellement, les climatologues prennent le problème à l’envers. Pour des raisons calculatoires, ils adoptent comme point de départ l’émission infrarouge de surface, et ils se focalisent sur le transfert radiatif à travers l’atmosphère, alors que le cheminement causal est inverse.

[4] Giec-IPCC “Most intercomparison studies on RF of greenhouse gases are for clear-sky” IPCC, WG1 Fifth Assestment Report, § 8.3.1, p. 8-18/124, ligne 17, www.climatechange2013.org/images/report/WG1AR5_SOD_Ch08_All_Final.pdf (consulté le 28/08/19)

[5] “The introduction of clouds would greatly complicate the targets of research” ibid., ligne 18.

[6] Phénomène atmosphérique et océanique complexe et périodique observable dans les zones pacifiques tropicales. Son origine est assez mal connue.

[7] Giec-Ipcc, WG1AR5, Fifth Assessment Report, chapter 10, Fig 10.5, p 111/131 , www.climatechange2013.org/images/report/WG1AR5_SOD_Ch10_All_Final.pdf (consulté le 28/08/19)

[8] “Attribution does not require, and nor does it imply, that every aspect of the response to the causal factor in question is simulated correctly”.

GIEC-IPCC, “Climate Change 2013 - The Physical Science Basis: Woking Group 1 contribution to the fith assesment report of the IPCC” , p. 873, www.ipcc.ch/site/assets/uploads/2018/02/WG1AR5_Chapter10_FINAL.pdf (consulté le 28/08/19)

[9] «22 of 23 groups reported adjusting model parameters to achive desired properties such as radiation balance at the top of the atmosphere”, source: Frédéric Hourdin, The Art and Science of Climate Model Tuning (L’art et la science du réglage des modèles climatiques), American Meteorological Society , 9 juillet 2016, https://journals.ametsoc.org/doi/full/10.1175/BAMS-D-15-00135.1 , (consulté le 18/08/19)

[10] Publication, intitulée Earth climate identification vs. anthropic global warming attribution ( Identification du système climatique vs. détection et attribution » et référencée par « ScienceDirect », revue, dans les règles, par les pairs du comité de lecture de Annual Reviews in Control (ARC), une des sept revues scientifiques de l'IFAC, Fédération internationale qui regroupe des milliers d'experts en contrôle, automatique et identification des systèmes complexes. www.sciencedirect.com/science/article/pii/S1367578816300931?via%3Dihub (consulté le 28/08/19)

[11] Giec-Ipcc, “Objective and subjective probabilities are not always explicitly distinguished”. Cette affirmation est le titre exact de la section 2.6.2 du Third Assessment Report of IPCC , “Contribution of the Working Group II: Impacts, Adaptation and Vulnerability”, p. 129, www.ipcc.ch/site/assets/uploads/2018/03/WGII_TAR_full_report-2.pdf (consulté le 28/08/19)

[12] Giec-Ipcc, AR5, Working Group 1, The Physical Science Basis, Report Graphics- Technical Summary- Box TS.5, fig 1-b, http://www.climatechange2013.org/report/reports-graphic/ts-graphics/ (consulté le 28/08/19).

[13] Leader mondial de la diffusion des publications scientifiques soumises à ces comités de lecture.

[14] La revue Sciences express a publié le 15 janvier 2015, une prétendue étude scientifique intitulée : "Planetary Boundaries: Guiding human development on a changing planet".

[15] Ingénieur agronome INAPG, ancien DGA du groupe Saint-Louis Sucre, [Direction commerciale et des relations institutionnelles (UE, OMC, …), administrateurs de filiales étrangères, ancien Membre de la Commission Spécialisée "marché à terme du sucre" jusqu’à sa fermeture]. Ancien président de la « Semaine du Goût ». Titulaire d’un 3ème cycle de bioéthique.

[16] Minutes du débat contradictoire (2 x 6 heures) auquel a participé l’auteur avec le Giec en 2012